Intelligenza artificiale, real world data e nuove normative stanno trasformando la produzione e l’uso delle evidenze cliniche.

Oggi, la questione centrale non è più la tecnologia in sé, ma il livello di fiducia che sistemi sanitari, professionisti e cittadini possono riporre nei risultati digitali. La domanda non è più se adottare soluzioni digitali, ma come garantire che le evidenze siano affidabili, governabili ed eque nel tempo.

Questo richiede strumenti concreti: standard chiari, incentivi per pratiche di governance efficaci, monitoraggio continuo delle performance e responsabilità lungo l’intero ciclo di vita delle soluzioni. Senza affidabilità sistemica, il mercato della sanità digitale resta frammentato, il procurement pubblico diventa incerto e gli investimenti si espongono a rischio regolatorio e reputazionale.

La fiducia non è un tema etico astratto: è una condizione operativa per la sostenibilità economica dell’innovazione.

Indice degli argomenti

La differenza tra accuratezza e affidabilità

Molti strumenti digitali mostrano ottime prestazioni in fase di sviluppo e validazione, ma incontrano difficoltà nell’applicazione alla pratica clinica reale. La distinzione tra accuratezza e affidabilità è quindi fondamentale per comprendere limiti e potenzialità della sanità digitale.

Un algoritmo può essere molto accurato in condizioni controllate, ma non garantire le stesse prestazioni nel contesto reale. Le performance variano tra popolazioni, strutture e nel tempo, a causa di cambiamenti nei dati, nelle pratiche cliniche e nell’uso.

Questo fenomeno, noto come data drift o model performance decay, si verifica quando la realtà clinica evolve mentre i modelli restano ancorati a dati storici e ipotesi iniziali. Un predittore di sepsi che funzionava eccellentemente in fase di test può subire un drastico calo di prestazioni dopo un aggiornamento del sistema EHR, evidenziando i rischi concreti del disallineamento tra modello e contesto. Anche modifiche apparentemente marginali, come l’aggiornamento di un percorso clinico o di una codifica informatica, possono alterare la calibrazione del sistema, aumentando i falsi positivi o i falsi negativi e incidendo sulla sicurezza.

L’affidabilità non è una proprietà intrinseca dell’algoritmo, ma una caratteristica dell’intero sistema. Dipende dalla qualità e rappresentatività dei dati, dalla trasparenza dei modelli, dall’integrazione nei flussi di lavoro, dalla formazione degli utenti, dalla gestione del rischio e dal monitoraggio continuo.

Non è sufficiente presentare una curva ROC favorevole o metriche iniziali elevate; occorre dimostrare utilità clinica nel tempo, considerando esiti, sostenibilità operativa e impatto organizzativo. Per i decisori pubblici, ciò significa dotarsi di strumenti di monitoraggio continuo e di quadri regolatori adattivi, capaci di accompagnare l’evoluzione tecnologica senza inseguirla ex post.

Ciò richiede tracciabilità dei dati, audit periodici delle prestazioni, gestione delle versioni e criteri chiari di intervento in caso di scostamenti. Senza questi presidi, la precisione iniziale può trasformarsi in variabilità non controllata.

Governance prima della tecnologia

Per i decisori pubblici e per il mercato, la governance dell’evidenza diventa tanto importante quanto la sua produzione. In assenza di una governance solida, l’adozione intensiva di dati e algoritmi può generare incertezza, contenzioso e nuove disuguaglianze, anziché supportare decisioni più efficaci.

Lo stesso vale per l’open innovation in sanità. La semplice condivisione dei dati non genera valore. Il progresso avviene quando ricerca, industria e istituzioni adottano standard comuni per la qualità dei dati, la validazione metodologica, i criteri di reporting e le responsabilità lungo il ciclo di vita. Senza un linguaggio condiviso, l’innovazione rischia di generare frammentazione e soluzioni non interoperabili. L’integrazione dei requisiti lungo tutto il ciclo di vita – dalla progettazione all’uso reale e agli aggiornamenti – rende l’innovazione più affidabile, scalabile e sostenibile.

In questa prospettiva, la regolamentazione non frena l’innovazione: la rende investibile. Regole chiare sulla documentazione, la tracciabilità e la responsabilità facilitano il procurement, l’HTA e le valutazioni di valore nel tempo.

Affidabilità ed equità

Un aspetto spesso trascurato è l’equità. Le tecnologie digitali non sono neutrali: riflettono i dati impiegati per l’addestramento e le scelte progettuali. L’equità non è un tema etico accessorio, ma un indicatore di qualità clinica. Numerosi studi documentano differenze significative nei tassi di errore diagnostico tra gruppi minoritari e popolazioni di riferimento, evidenziando come l’iniquità possa tradursi in un problema concreto di sicurezza. L’evidenza digitale può essere considerata solida solo se dimostra prestazioni affidabili su popolazioni eterogenee, in contesti diversi e nel tempo. La sola performance media non basta: servono analisi per sottogruppi, valutazioni di accessibilità e attenzione all’usabilità.

L’affidabilità dell’evidenza digitale deriva da un equilibrio dinamico tra la qualità dei dati, la capacità di monitoraggio, la trasparenza dei modelli, la solidità organizzativa e l’attenzione sistematica all’equità.

La maturità della sanità digitale non si riduce a un singolo indicatore. La copertura del Fascicolo Sanitario Elettronico, l’uso, la telemedicina, l’interoperabilità e l’equità territoriale sono dimensioni interdipendenti. Un’analisi isolata può dare un’immagine parziale.

L’Indice di Affidabilità ed Equità Digitale Territoriale (IAED-T)

Si propone di integrare le suddette dimensioni in uno score composito, anticipando un Indice di Affidabilità ed Equità Digitale Territoriale (IAED-T), che renda osservabile e confrontabile la maturità digitale.

Nota: i valori riportati nelle tabelle che seguono non vanno intesi come statistiche ufficiali precise, bensì come approssimazioni coerenti con le evidenze pubbliche disponibili, per evidenziare dinamiche di governance altrimenti implicite.

| Dimensione | Descrizione | Indicatori osservazionali | Fonte |

| D₁ | Disponibilità e qualità dei dati | Copertura FSE, disponibilità documenti | Ministero della Salute – Monitopen |

| D₂ | Utilizzo e continuità operativa | Accessi FSE cittadini | Monitopen; Osservatorio Sanità Digitale (Politecnico di Milano) |

| D₃ | Capacità di servizio digitale | Diffusione telemedicina (proxy) | Agenas – PNRR Missione 6 |

| D₄ | Infrastruttura e interoperabilità | Standard e uniformità FSE | Ministero della Salute – Portale FSE |

| D₅ | Equità | Divari regionali di accesso e utilizzo | Analisi su dati FSE |

Tabella 1 – Metodo di costruzione del “composite score”

| Regione / PA | Utilizzo FSE (%) | Consenso FSE (%) | Nota |

| PA Trento | ~64 | >90 | Elevata maturità storica |

| Emilia-Romagna | ~40 | ~92 | Modello di riferimento |

| Veneto | ~23 | ~70 | Infrastruttura solida, uso moderato |

| Lombardia | ~18-23 | ~65 | Gap tra offerta e utilizzo |

| Campania | ~18-23 | ~10-15 | Barriere di accesso |

| Calabria | ~1 | ~1 | Divario strutturale |

| Sicilia | ~1 | ~1 | Divario strutturale |

Tabella 2 – Indicatori regionali selezionati (livello osservazionale)

| Profilo territoriale | D₁ | D₂ | D₃ | D₄ | D₅ | Composite score |

| Alta maturità | 75 | 70 | 80 | 75 | 70 | ~74 |

| Maturità intermedia | 55 | 45 | 65 | 50 | 45 | ~52 |

| Bassa maturità | 30 | 20 | 40 | 30 | 20 | ~28 |

| Italia (stima) | ~30 | ~42 | ~72 | ~30 | ~40 | ~43-45 |

Tabella 3 – Composite score (livello di sintesi)

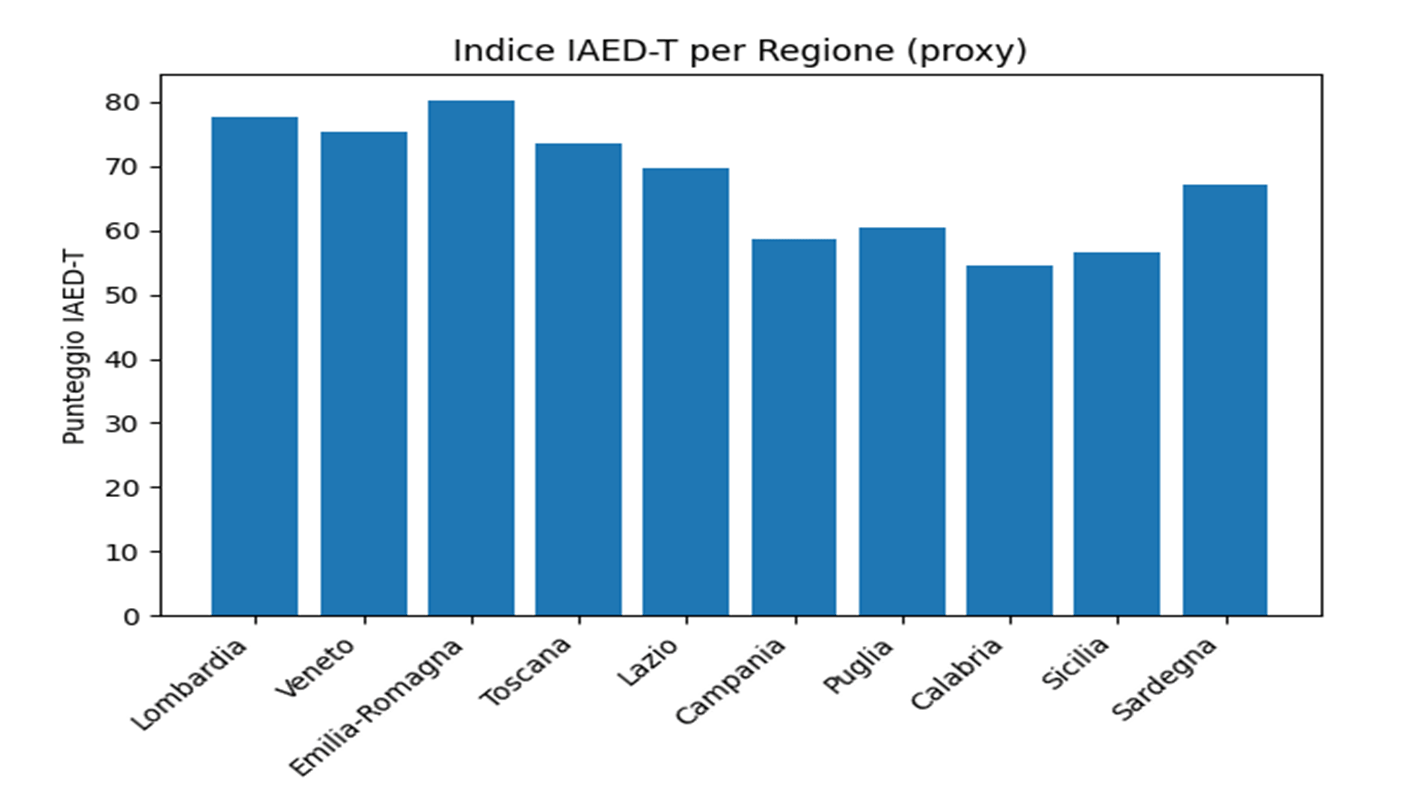

Nel quadro metodologico analizzato, si colloca l’Indice di Affidabilità ed Equità Digitale Territoriale (IAED-T), concepito come strumento operativo per sintetizzare e rendere confrontabile la maturità sistemica della sanità digitale nei diversi territori.

L’indice non misura la semplice presenza di tecnologie, ma la capacità di governare l’evidenza digitale nel tempo, integrando disponibilità, utilizzo, interoperabilità, capacità di servizio ed equità.

Le rappresentazioni che seguono operano su due livelli: una lettura osservazionale basata su proxy pubblici e una simulazione sintetica utile a visualizzare scenari di maturità sistemica. L’obiettivo non è stilare classifiche definitive, ma rendere trasparente la struttura delle differenze territoriali e individuare priorità di intervento.

Per i decisori pubblici, uno strumento di questo tipo consente di calibrare investimenti, monitorare l’evoluzione nel tempo e verificare se la digitalizzazione si traduca effettivamente in valore clinico e affidabilità sistemica.

Rappresentazione sintetica dei profili di maturità digitale territoriale

Per rendere visibile la logica di integrazione multidimensionale, proponiamo una rappresentazione sintetica per profili tipologici di maturità. La figura 1 non intende classificare territori reali, ma illustrare come le cinque dimensioni possano combinarsi generando configurazioni sistemiche differenti.

L’istogramma visualizza la combinazione delle cinque dimensioni (D1 – D5) che compongono il composite score, evidenziando differenze strutturali tra profili ad alta, intermedia e bassa maturita’. I valori hanno funzione illustrativa e descrivono scenari tipologici utili a comprendere la logica di integrazione multidimensionale alla base dell’IAED-T

A titolo esemplificativo, applichiamo quindi la logica dell’IAED-T a un set regionale simulato, integrando dimensioni infrastrutturali, di utilizzo, capacità di servizio ed equità. L’obiettivo non è produrre un ranking definitivo, ma mostrare come uno strumento sintetico possa supportare letture comparative e orientare le priorità di governance.

| Regione | Copertura FSE % | Utilizzo FSE % | Telemedicina | Interoperabilità | Equità | IAED-T |

| Lombardia | 98 | 65 | 75 | 80 | 70 | 77.6 |

| Veneto | 97 | 62 | 72 | 78 | 68 | 75.4 |

| Emilia-Romagna | 99 | 70 | 78 | 82 | 72 | 80.2 |

| Toscana | 96 | 60 | 70 | 75 | 66 | 73.4 |

| Lazio | 95 | 55 | 68 | 70 | 60 | 69.6 |

| Campania | 92 | 40 | 55 | 58 | 48 | 58.6 |

| Puglia | 93 | 42 | 57 | 60 | 50 | 60.4 |

| Calabria | 90 | 35 | 50 | 52 | 45 | 54.4 |

| Sicilia | 91 | 38 | 52 | 55 | 47 | 56.6 |

| Sardegna | 94 | 50 | 65 | 68 | 58 | 67.0 |

Tabella 4 – Simulazione applicativa dell’IAED-T a livello regionale (valori indicativi).

La tabella integra dimensioni infrastrutturali, di utilizzo e di equità in un indice sintetico comparabile. I valori sono espressi come proxy coerenti con evidenze pubbliche disponibili e hanno finalità interpretativa, non certificativa

Nota – Laddove non disponibili indicatori regionali ufficiali standardizzati, i valori riportati sono espressi come ordini di grandezza e proxy coerenti con le evidenze pubbliche disponibili, utilizzati a fini interpretativi e di governance.

Dal dato al valore

Il vero cambio di paradigma non è rendere disponibili strumenti digitali, ma garantire che producano valore clinico reale nella routine. Le politiche sanitarie devono investire non solo nelle tecnologie, ma nella governance, nel monitoraggio continuo e nell’accountability.

Strumenti di sintesi come l’IAED-T non sostituiscono l’analisi tecnica, ma rendono osservabile ciò che altrimenti resterebbe implicito: la coerenza tra infrastruttura, utilizzo, capacità organizzativa ed equità territoriale.

In questo senso, uno score composito non è un esercizio statistico, ma un’infrastruttura di trasparenza.

Il passaggio non è dall’analogico al digitale, ma dal dato all’evidenza, e dall’evidenza alla fiducia. La fiducia non si programma: si governa. E si governa rendendo misurabile nel tempo la qualità sistemica delle scelte digitali.

Senza governance, l’innovazione resta sperimentazione.

Con governance, diventa valore pubblico.